“你了解人工智能行业吗?”

10个人中可能有9个人会给出肯定的回答。

“你了解数据标注行业吗?”

10个人中可能有9个人会茫然地摇头。

与处在聚光灯中心的人工智能科技公司不同,数据标注行业长期处于聚光灯之外的灰色地带,很长一段时间内都是被边缘化乃至低视的一个存在。

不过,随着时代发展带来需求的改变,数据标注行业也在发生着日新月异的变化,开始从幕后走向前台。

一.幕后:粗放与混乱交织

数据标注行业里流传着这样的一段话:“有多少智能,就有多少人工”。

这句话在某种程度上道出了人工智能的本质。

事实上,现阶段让AI提升认知世界能力的最有效途径仍然是监督学习,而目前AI算法能学习的数据,几乎全部都是通过人力逐一进行标注而得来的。

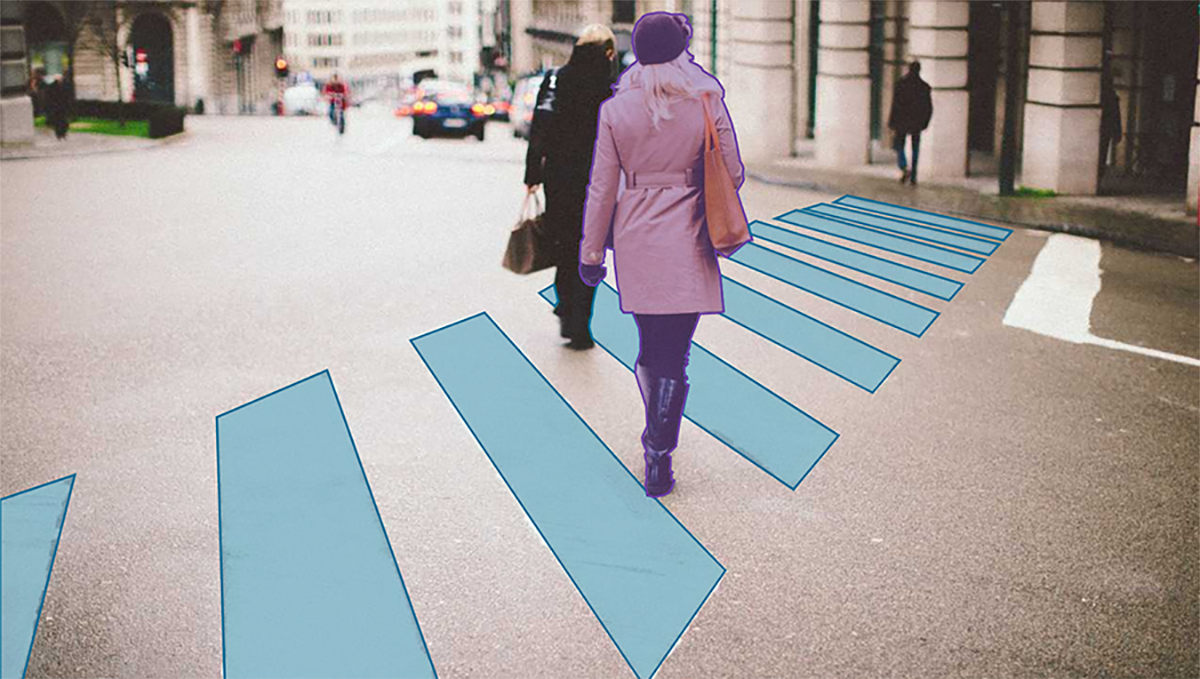

一张经过数据标注后的图片

需求即意味着市场,据相关机构预测,未来几年,国内数据服务市场将达上百亿。

如此庞大的市场规模,让很多人都想趁机分一杯羹,于是大大小小的标注团队如雨后春笋一样大量出现。

然而,问题也随之而来。

与人工智能高科技含量不同,数据标注仍属于劳动密集型产业,且模式通常以外包形式为主。

标注员每天从事标框、拉点等重复枯燥的工作,劳动力水平参差不齐导致产出的标注数据质量偏低,无法满足AI企业的需求,影响AI产品商业化落地进程。

与此同时,低端产能过低的技术含量,也使数据标注行业几乎没有任何壁垒限制,很多标注团队随意拉进来几个人经过简单培训就可以接业务了。

这样的后果就是行业混乱且竞争加剧,绝大部分标注团队只能存活于产业链最底层,压价情况严重,甚至接不到业务导致生存艰难。

二.前台:AI对于高质量数据的依赖

人工智能行业内有一个很重要的共识:

数据集质量的高低直接决定最终模型效果的好坏。

换句话说,数据对于模型性能的贡献是最大的,数据越多越丰富、代表性越强、模型效果越好,算法的健壮性和鲁棒性就越强。

随着AI企业商业化落地进程的加快,越来越多的企业开始意识到标注数据的重要性。

以自动驾驶为例,目前很多企业都已经生产出自己的无人驾驶汽车样车,并频频出现在公共视野内。

然而,虽然这些样车在实验室内表现良好,但距离真正的商用仍然有很遥远的距离,一个很重要的原因就是真实路况场景与实验室场景差距过大。

自动驾驶标注场景

在实验室内,只需要少量的道路数据即可满足实验的需要,但是到了真实的道路上,无人驾驶汽车将会遇到很多无法预知的情况,在没有足够数据支撑的前提下,车载电脑无法做出自己的判断,导致潜在的风险剧增。

因此,以自动驾驶企业为代表的众多AI企业对数据标注行业提出了更高的要求,数据标注行业已然开始处于聚光灯的焦点,从幕后走向了前台。

三.未来:智能化、精细化、场景化

AI数据是人工智能的重中之重。众所周知,人工智能的三驾马车是算法、算力与数据,其中数据是人工智能行业的发展基石。

随着人工智能行业商业化落地进程的加快,AI数据服务领域泥沙下沉,清泉上涌,行业变革已初露端倪。未来,智能化、精细化、场景化将是数据标注行业的主要发展方向。

智能化,即意味着标注工具AI化。以曼孚科技自研的语音标注工具为例,AI预标注技术可以自动识别转写语音数据,标注员只需要在工具预标注的结果上略作修改即可,这在提升标注效率的同时也减轻了对于人力的依赖。

精细化,即意味对标注数据集质量与细节提出了新的要求。以往数据集的准确率可能达到90%以上即可满足要求,但随着AI商业化落地进程的加快,AI企业对于标注数据的质量要求达到了95%,甚至99%以上,同时更加注重细节,比如曼孚科技在进行自动驾驶领域数据标注业务时,项目方会对诸如情绪捕捉、疲劳驾驶等等提出更加细节化的标注需求。

精细化标注能力

场景化,即意味数据标注行业要满足多样化应用场景标注需求。以计算机视觉领域为例,目前数据标注可以应用在自动驾驶、无人机、AI教育、工业机器人、新零售、安全防护等场景中。每一个应用场景都有自己的数据类型与具体标注要求,因此极为考验数据标注企业的场景化标注能力。

可以预见的是,未来几年数据标注行业将迎来一场大变革,理念更先进、技术更硬核、服务更专业的AI数据服务企业将会把数据标注行业带入全新的精细化运营时代。

而未来,相信随着5G技术的逐步应用,数据与5G的结合将碰撞出更多创新火花,共同托起AI发展的基石。